글_ 멘기스티 베리후 기르마이(Mengisti Berihu Girmay)

농업은 다른 많은 산업과 마찬가지로 기술 혁신을 통해 끊임없이 발전하고 있습니다. 대표적인 예가 정밀 농업으로, 이는 데이터 수집 및 분석을 통해 물, 비료, 농약과 같은 투입 자원의 사용을 최적화하는 방식입니다. 인공지능(AI)과 저비용 센서의 등장은 정밀 농업에 대한 관심을 다시 불러일으켰고, 이제는 축산업까지 그 적용 분야가 확대되었습니다. 특히 기술 비용이 낮아지면서 저소득 및 중간 소득 국가(LMIC)의 소규모 농가에서도 이러한 도구에 더 쉽게 접근할 수 있게 되었습니다.

축산업에서는 동물에 부착된 센서나 축사에 설치된 센서가 생리학적, 환경적 매개변수를 실시간으로 모니터링합니다. AI 기반 패턴 인식 기술과 결합된 이 도구들은 이미지 데이터를 통해 동물의 건강 문제(예: 절뚝거림)를 감지하거나, 소리 분석을 통해 호흡기 질환(예: 기침)을 발견할 수 있습니다. 이는 동물의 복지를 향상시킬 뿐만 아니라 조기 개입을 가능하게 하여 항생제 사용을 줄이고 대규모 질병 발생을 예방하는 데 도움을 줍니다.

하지만 이러한 유망한 기술에도 불구하고, AI 도구는 농부들에게 심각한 우려를 불러일으킬 수 있습니다. 특히 예측의 근거가 불분명할 때 더욱 그렇습니다. 오류, 감시, 통제력 상실에 대한 두려움은 신뢰를 약화시킬 수 있습니다. 만약 AI 도구가 불투명하거나 외부에서 강요된 것으로 인식된다면, 농부들은 그저 사용하지 않을 것입니다. 따라서 AI가 축산 시스템의 의사결정을 복잡하게 만드는 것이 아니라 지원하기 위해서는, AI를 직관적이고 투명하게 만들고 농부들의 현실에 맞추는 것이 필수적입니다.

‘설명가능성’이 중요한 이유

의사결정 논리가 사전에 정의되어 투명한 기존의 규칙 기반 컴퓨터 프로그래밍과 달리, 많은 AI 모델은 ‘블랙박스(black box)’처럼 작동합니다. 이는 사용자는 물론 개발자조차도 특정 결론에 어떻게 도달했는지 정확히 이해하기 어렵거나 불가능하게 만듭니다.

이러한 블랙박스 문제는 농업 AI 분야에서 특히 신뢰의 문제를 야기합니다. 만약 농부들이 자신의 생계에 영향을 미칠 수 있는 농업 관행에 대한 지침을 AI 앱에서 얻고 있지만, AI 기반 추천의 근거를 이해하지 못한다면, 그들은 추천이나 시스템 전체를 무시하거나 거부할 수 있습니다.

예를 들어, AI 기반 관개 스케줄링 도구는 일기 예보와 토양 수분 센서 데이터를 기반으로 관개를 줄이라고 제안할 수 있고, 가축 모니터링 시스템은 목초지 품질이나 체중 증가 목표에 따라 사료 구성을 조정하라고 추천할 수 있습니다. 만약 시스템이 생성한 이러한 추천이 농부 자신의 판단과 일치하지 않고 아무런 설명도 제공되지 않는다면, 농부들은 AI가 생성한 추천보다 자신의 경험과 직감을 더 신뢰할 가능성이 높습니다.

이것이 바로 ‘설명가능성(explainability)’—AI 모델의 의사결정 과정을 사용자에게 투명하고 이해하기 쉬운 방식으로 공개하는 개념—이 농업 AI에 중요한 이유입니다. ‘설명가능성’은 시스템이 기반 데이터(예: 날씨 조건이나 동물 건강 매개변수)가 결정에 어떻게 그리고 어느 정도로 영향을 미쳤는지를 전달하는 것을 의미합니다.

이러한 평가를 지원하기 위해 이해하기 쉬운 설명을 제공하는 것은 신뢰를 구축하는 핵심일 뿐만 아니라, 윤리적이고 투명한 AI 연구의 중요한 측면이기도 합니다. 이는 사용자와 연구 참여자가 정보에 입각한 결정을 내리고 AI 시스템과 상호작용하거나 의존할 때 무엇에 동의하는지 완전히 이해하도록 보장합니다.

일반적으로 설명가능성은 AI 내부 개발 과정의 일부로, 엔지니어들이 모델의 행동을 해석하고 개선하는 데 도움을 줍니다. 하지만 우리는 최종 사용자도 고려해야 합니다. 최종 사용자인 농부들은 AI 모델의 내부 작동 방식보다는, 그 결과에 대한 명확한 해석과 그에 기여한 요인에 더 관심이 있을 가능성이 높습니다.

설명가능성 구현의 과제

AI 모델에 대한 좋은 설명이 무엇인지에 대한 질문은 여러 요인에 따라 달라집니다. 좋은 출발점은 설명의 대상 청중이 누구인지를 묻는 것입니다.

농업의 AI 설명가능성은 단순히 농부에 초점을 맞추는 것을 넘어, 농업 시스템의 방대한 다양성을 고려하여 사용자 그룹을 더 잘 이해함으로써 더욱 발전할 수 있습니다. 농장은 규모, 전문 분야, 기술 사용, 직원의 전문 지식 및 디지털 리터러시 측면에서 크게 다릅니다. 특히 저소득 및 중간 소득 국가의 소규모 농가를 지원하기 위해서는 맞춤형 설명가능성이 필요합니다.

데이터 보호 또한 많은 농부들에게 AI 도입의 주요 장애물이 될 수 있습니다. 농부들은 AI 도구가 자신의 농장에서 데이터를 수집하고, 이 데이터가 도구 개발자에 의해 처리되거나 판매될 수 있다는 점을 당연히 우려할 수 있습니다. 또한 정부 기관이 이 데이터에 대한 접근을 요청하고 이를 과세의 근거나 증액에 사용할 것을 걱정할 수도 있습니다. 질병 발생 시, 당국은 농장 데이터를 사용하여 격리를 정당화하거나 가축의 도살을 명령할 수 있으며, 이는 지역 생계에 파괴적인 결과를 초래할 수 있습니다. 따라서 AI 설명가능성의 또 다른 핵심 부분은 농장 데이터가 어디서, 어떻게, 누구에 의해 처리되는지를 전달하는 것이어야 합니다.

설명가능성 요구에 대한 사례 연구

독일에서 수행된 연구에서, 우리는 유제품 농부와 소프트웨어 제공업체가 AI 기반 축군 관리 시스템의 설명가능성을 어떻게 인식하는지 조사했습니다. 연구는 전 세계 유제품 부문, 특히 저소득 및 중간 소득 국가에서 주요 관심사인 유선염(mastitis)에 초점을 맞췄습니다. 유선염은 유제품 부문의 주요 경제적 손실 원인 중 하나이며 항생제 사용의 주요 원인입니다.

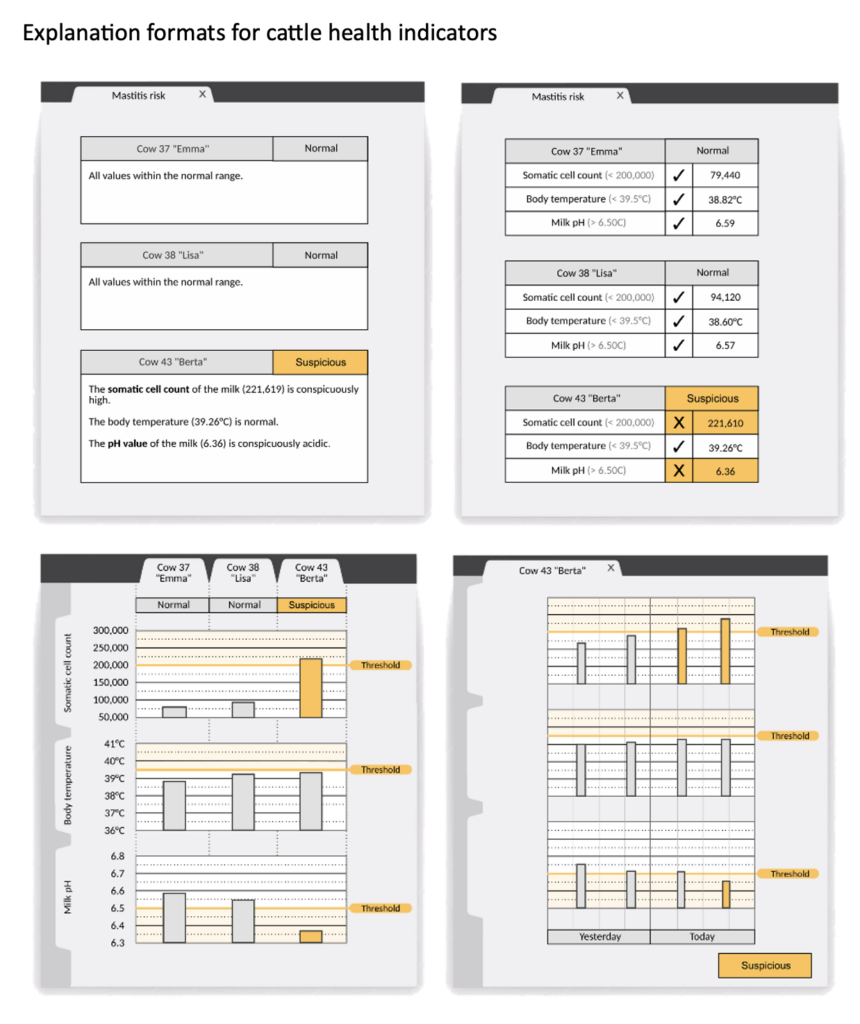

체온, 체세포 수, 우유 pH와 같은 지표를 모니터링함으로써 조기 발견이 가능하며, 감염이 심각해지기 전에 치료할 수 있습니다. 이 매개변수들은 두 개의 관련 연구에서 테스트되었습니다. 첫 번째 연구에는 14명의 농부가, 두 번째 연구에는 14명의 농부와 13명의 소프트웨어 제공업체가 모두 참여했습니다. 모든 경우에 참가자들은 위 매개변수들이 평가에 기여하는 다양한 방식을 반영하는 네 가지 설명 형식을 평가했습니다.

- 텍스트 기반: 자연어 설명을 사용하여 소의 건강 상태를 설명.

- 규칙 기반: 체크리스트를 사용하여 어떤 매개변수가 정상인지 비정상인지를 표시.

- 축군 비교: 특정 소의 매개변수를 나머지 축군 전체와 비교.

- 시계열: 그래프를 사용하여 시간 경과에 따른 소의 매개변수 변화를 표시.

연구 결과, 농부들이 선호하는 설명 형식과 소프트웨어 개발자들이 선호하는 형식이 다른 것으로 나타났습니다. 농부들은 주로 시계열 형식이 유용하고 실행 가능하다고 평가했으며, 시간 경과에 따른 동물 매개변수의 변화가 직관적인 통찰력을 제공한다고 언급했습니다. 반면, 많은 소프트웨어 제공업체들은 농부들이 항상 시간 압박에 시달려 시계열 데이터를 검토할 시간이 없을 것이라고 가정하고, 구조화되고 간결한 개요를 제공하는 규칙 기반 설명이 더 적합하다고 생각했습니다.

이와 같은 불일치는 중요한 결과를 초래할 수 있습니다. 만약 개발자들이 사용자 요구에 대한 부정확한 가정에 의존한다면, 그 결과로 만들어진 도구는 현장 실무자들의 요구사항과 잘 맞지 않아 결국 효과성과 채택률이 제한될 위험이 있습니다.

긍정적인 측면에서, 이러한 통찰은 명확한 개선 기회를 보여줍니다. 농부들의 작업 흐름과 요구를 더 잘 이해하기 위해 사용자 중심 연구를 통합하면, 기술적으로 견고할 뿐만 아니라 실제 현장에서 농부들에게 실용적이고 관련성 있는 설명을 설계하고 개발하는 데 도움이 될 수 있습니다.

*이 글의 저자인 멘기스티 베리후 기르마이(Mengisti Berihu Girmay)는 카이저슬라우테른-란다우 대학교의 박사 과정 학생이며, 컴퓨터 과학과 디지털 농업 분야에서 연구하고 있습니다. 그녀의 연구는 디지털 농업 분야의 인간-컴퓨터 상호작용, 특히 낙농가를 위한 설명가능한 의사결정 지원 시스템의 설계 및 개발에 중점을 두고 있습니다. 그녀는 농업 환경에서 AI의 투명성, 신뢰성, 수용성을 향상시키기 위한 사용자 중심 설계 접근 방식에 특히 관심이 많습니다. 본 글의 의견은 저자 개인의 것입니다.

참고 논문:

- Girmay, Mengisti Berihu and Möhrle, Felix. (2024). Perspectives on Explanation Formats From Two Stakeholder Groups in Germany: Software Providers and Dairy Farmers.

- Girmay, Mengisti Berihu, Möhrle, Felix, and Henningsen, Jens. (2024). Exploring explainability formats to aid decision-making in dairy farming systems A small case study using the example of mastitis infection.

*호미농부는 본 게시물을 단순 한글 번역만 진행하였습니다. 본 포스트의 원문은 (여기 링크)에서 확인하실 수 있습니다.

![[호미농부의 Tech Lab] 스마트폰으로 끝내는 농업경영체 변경 (농업e지 편) [호미농부의 Tech Lab] 스마트폰으로 끝내는 농업경영체 변경 (농업e지 편)](https://smartnongup.kr/wp-content/uploads/2025/09/20250606_galicbbat-125852.jpg)

![[농기평] 인공지능이 농사 고수라고요? [농기평] 인공지능이 농사 고수라고요?](https://smartnongup.kr/wp-content/uploads/2026/02/IPET-top-title-410x260.png)

![[카드뉴스] 농업전망 2026 세부 프로그램 및 무료 등록 안내 [카드뉴스] 농업전망 2026 세부 프로그램 및 무료 등록 안내](https://smartnongup.kr/wp-content/uploads/2026/01/card0.png)